Dans un monde où les volumes de données explosent chaque jour, la maîtrise d’outils performants pour leur analyse devient indispensable. Python, par son langage clair et son écosystème riche, s’est rapidement imposé comme un allié incontournable dans la data science. En combinant pandas, NumPy et matplotlib, les professionnels et passionnés peuvent extraire, manipuler et visualiser des données complexes avec une efficacité remarquable. Ce trio constitue la base pour transformer des données brutes, venues de sources variées telles que les logs, les bases clients ou les ventes, en analyses précises et actionnables.

Les entreprises en 2026 s’appuient largement sur ces bibliothèques Python pour améliorer leurs prises de décision, optimiser leurs stratégies marketing ou encore anticiper les tendances du marché. Ce tutoriel méthodique s’adresse à ceux qui souhaitent découvrir ou approfondir leurs connaissances en analyse de données avec Python, en proposant des exemples concrets et des bonnes pratiques à adopter. L’apprentissage s’appuie sur la puissance de NumPy pour les calculs mathématiques rapides, la structure intuitive de pandas pour la manipulation de tableaux et la capacité d’analyse graphique de matplotlib, pour offrir une vue complète et pratique de l’analyse de données en Python.

Les raisons du succès de Python en analyse de données avec pandas et NumPy

La popularité de Python dans la programmation orientée data s’explique par plusieurs atouts majeurs. Sa syntaxe lisible et concise facilite la prise en main, essentielle pour les data scientists et analystes qui doivent jongler avec des datasets complexes. Le large éventail de bibliothèques disponibles, parmi lesquelles pandas et NumPy, assure une couverture complète des besoins, du prétraitement au calcul scientifique.

NumPy offre un avantage clé par sa gestion optimisée des tableaux multidimensionnels appelés ndarray, qui permettent un traitement rapide et vectorisé des données numériques. En complément, pandas structure ces données sous format Series et DataFrame, apportant ainsi une manipulation fluide des données tabulaires, indispensable pour des opérations courantes comme le filtrage, le regroupement et la jointure.

Le tout est renforcé par une communauté active et une documentation riche, facilitant la résolution des difficultés rencontrées. En suivant les évolutions récentes, notamment la transition de Python 2 à Python 3, il est possible d’exploiter pleinement les fonctionnalités modernes et performantes. Pour approfondir la syntaxe claire qui caractérise le langage, on peut consulter des ressources dédiées comme cette synthèse sur la syntaxe Python.

Installation et configuration de l’environnement Python pour l’analyse de données

La réussite d’un projet en analyse de données passe par un environnement propre, dédié et bien configuré. Il est conseillé d’utiliser un environnement virtuel, via conda ou venv, pour isoler les dépendances et éviter les conflits entre bibliothèques. Voici une configuration de base fréquemment adoptée :

Pour conda :

conda create -n dataenv python=3.10

conda activate dataenv

Pour venv :

python3 -m venv dataenv

source dataenv/bin/activate # ou dataenvScriptsactivate sous Windows

Une fois l’environnement activé, il faut installer les bibliothèques nécessaires à l’analyse et la visualisation de données :

pip install numpy pandas matplotlib seaborn jupyter

Pour naviguer naturellement entre exploration interactive et écriture de scripts, l’usage de notebooks Jupyter reste incontournable, tandis que des IDEs comme VS Code ou PyCharm améliorent la productivité pour des projets plus conséquents.

Les fondamentaux de NumPy pour la manipulation efficace de tableaux

NumPy est la pierre angulaire pour toute opération numérique. Son objet central, le tableau ndarray, supporte des structures allant jusqu’aux dimensions multiples, avec des calculs vectorisés qui éliminent la nécessité de boucles classiques lentes. La création de ces tableaux est simple et flexible, via des fonctions comme np.array(), np.zeros(), ou np.linspace().

Cette vectorisation facilite des opérations répétées, par exemple des additions ou multiplications d’entiers et flottants, réalisées instantanément sur l’ensemble des éléments. On peut aussi appliquer des fonctions universelles (ufunc), comme le sinus ou le logarithme, qui accélèrent le traitement statistique et scientifique.

Grâce à la capacité d’indexation étendue, NumPy permet de sélectionner, filtrer et trancher les tableaux avec précision, indispensable pour traiter les données spécifiques contenues dans un ensemble volumineux.

Plus de détails concernant les structures avancées et le traitement des matrices sont disponibles sur ce guide dédié aux tableaux et matrices en Python.

Manipuler les données tabulaires avec pandas pour une analyse puissante

Les tables de données, constituant souvent le cœur des analyses, sont efficacement manipulées avec pandas, qui propose les structures Series et DataFrame. Ces dernières représentent successivement des vecteurs annotés et des tableaux à deux dimensions avec étiquettes sur les lignes et colonnes. Cette organisation permet d’accéder aisément aux données, de les filtrer ou transformer en quelques lignes.

La lecture et l’écriture de nombreux formats de fichiers, notamment CSV ou Excel, s’effectuent simplement via pandas, facilitant le traitement de fichiers volumineux issus du travail quotidien.

Par exemple, les fonctions df.head(), df.describe() ou df.groupby() permettent de visualiser rapidement les grandes tendances d’un jeu de données, comme la moyenne, l’écart-type, ou les répartitions conditionnelles, offrant un socle robuste pour des analyses fines.

Pour mieux appréhender les opérations avancées associées aux DataFrames, la fusion et les jointures, une ressource complète est disponible sur les opérations de fusion avec pandas.

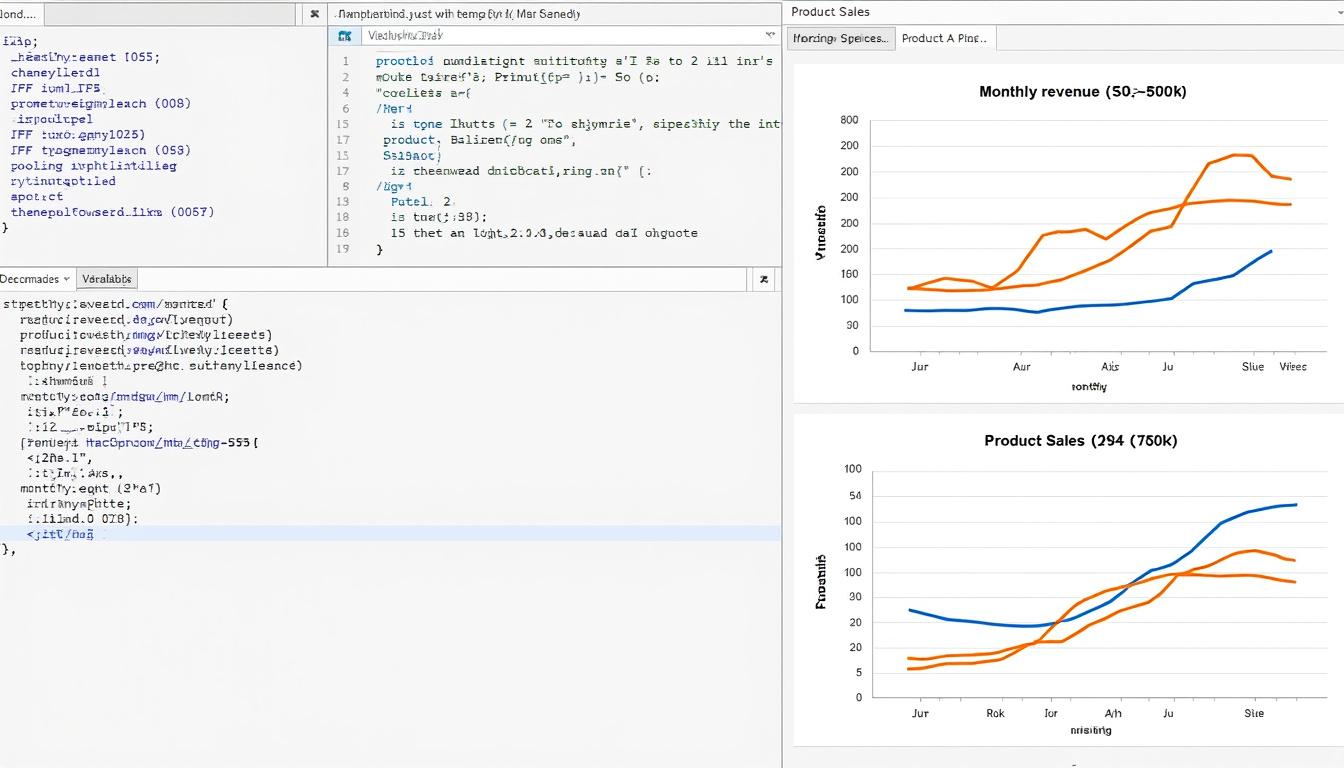

Étude de cas pratique : analyse des ventes mensuelles d’une boutique e-commerce

Un exemple concret illustre parfaitement l’usage combiné de ces bibliothèques. Imaginons une boutique en ligne souhaitant analyser ses ventes mensuelles afin d’identifier les tendances et optimiser ses stocks. Le fichier CSV « ventes.csv » contient les colonnes clés : date_vente, produit, quantité, prix_unitaire et client_id.

On commence par charger les données avec pandas, puis on extrait de nouvelles colonnes telles que l’année, le mois et le montant total par vente (quantité * prix unitaire). Ensuite, le regroupement par mois permet d’obtenir le chiffre d’affaires mensuel.

L’étape suivante consiste à déterminer le produit le plus vendu chaque mois en quantité, tout en calculant la croissance du chiffre d’affaires mois par mois. Les résultats sont visualisés à l’aide de matplotlib et seaborn, afin de suivre les variations et mieux comprendre les performances commerciales.

Cette méthode, reproductible et adaptable à d’autres secteurs, souligne le rôle clé de la programmation Python, conjuguée à la manipulation de données et la visualisation de données pour lever des insights stratégiques.

Recommandations et bonnes pratiques pour un travail efficace avec pandas et NumPy

Travailler sur des jeux de données réels demande rigueur et anticipation des pièges potentiels. Avant toute analyse, il convient de nettoyer les données, en supprimant ou imputant les valeurs manquantes, et en éliminant les doublons. La conversion explicite des types des colonnes assure une cohérence et évite les erreurs lors du traitement.

Il est crucial d’éviter les itérations ligne par ligne au profit des opérations vectorisées de pandas ou NumPy, ce qui garantit des performances optimales. La gestion attentive des avertissements, notamment le SettingWithCopyWarning, prévient les bugs subtils liés à la modification de vues sur les DataFrames.

Pour ceux qui manipulent de très grands volumes, la réduction de la mémoire utilisée par le choix pertinent des types de données et le traitement par morceaux (chunks) optimise les performances. En cas de datasets très lourds, des alternatives comme Dask ou Vaex peuvent être envisagées.

Maintenir une documentation claire et un code bien structuré facilite la maintenance et la collaboration, essentielle dans une équipe ou sur des projets de longue durée.

Pourquoi utiliser Python plutôt qu’un autre langage pour l’analyse de données ?

Python combine simplicité syntaxique, écosystème riche et fonctionnalités avancées, ce qui facilite la manipulation et la visualisation des données complexes. Ses bibliothèques comme pandas et NumPy sont optimisées pour la performance sur de grands volumes.

Comment éviter les erreurs courantes lors de la manipulation de DataFrame ?

Il faut toujours vérifier les types de données, gérer les valeurs manquantes, utiliser les fonctions vectorisées pour éviter les boucles, et faire attention aux avertissements comme SettingWithCopyWarning en manipulant les vues.

Quels outils recommander pour un débutant souhaitant apprendre l’analyse de données en Python ?

L’environnement Jupyter Notebook combiné à l’installation de pandas, NumPy et matplotlib dans un environnement virtuel est idéal. Ensuite, des IDE comme VS Code peuvent aider à structurer les projets plus complexes.

Peut-on utiliser Python pour la visualisation avancée au-delà de matplotlib ?

Oui, des bibliothèques comme Seaborn ou Plotly permettent d’aller plus loin en personnalisant les graphiques et en offrant des visuels plus interactifs adaptés à la présentation des données.

Quelles perspectives professionnelles offre la maîtrise de pandas et NumPy ?

La connaissance approfondie de ces outils ouvre des postes qualifiés tels que Data Analyst, Data Scientist ou développeur Python spécialisé. Il existe également de nombreuses opportunités dans le freelancing et le développement de produits SaaS basés sur l’analyse de données.