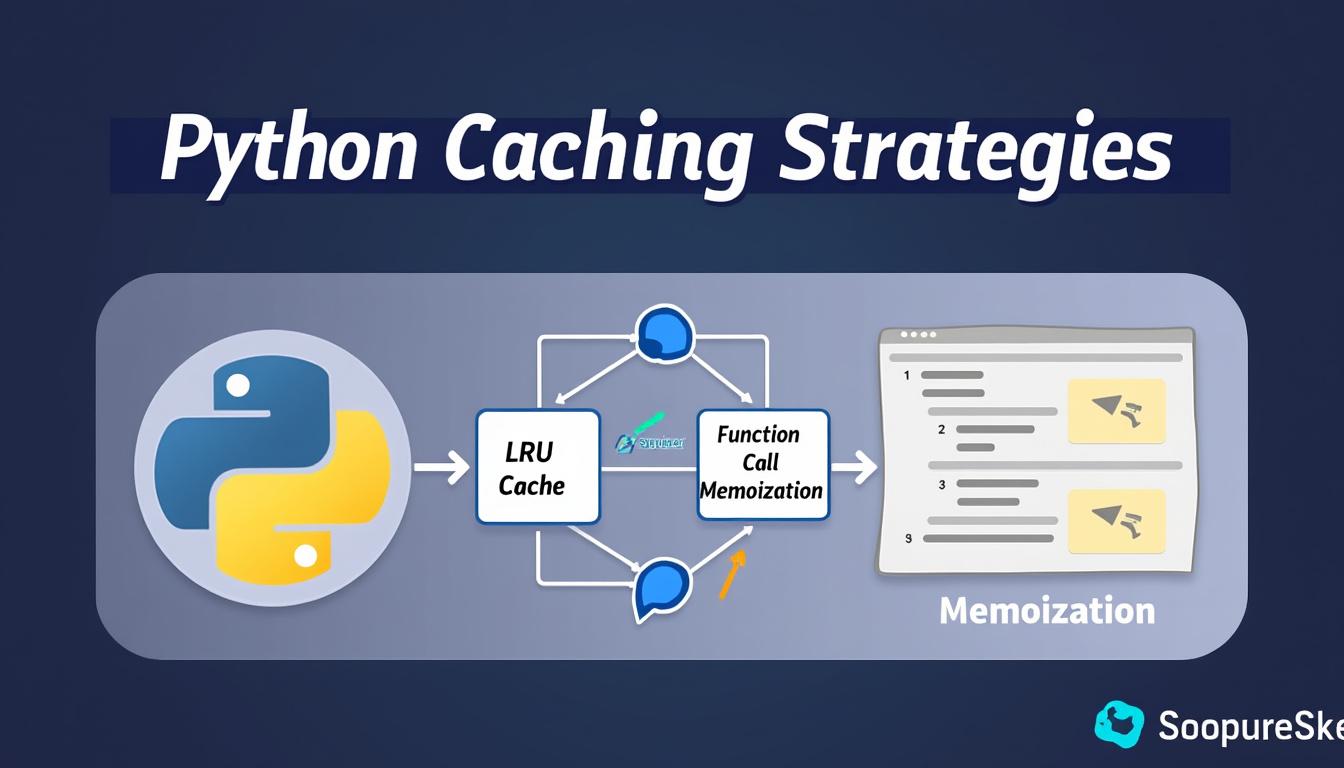

La mise en cache est un levier essentiel pour optimiser les performances des applications Python en 2026, notamment lorsque les calculs ou traitements se répètent fréquemment avec les mêmes données. Le module functools, inclus nativement dans Python, fournit à cet effet des outils efficaces tels que le décorateur lru_cache qui implémente une stratégie de mise en cache basée sur l’algorithme du « Least Recently Used » (LRU). Ce mécanisme mémorise les résultats de fonctions coûteuses afin de réduire drastiquement le temps d’exécution lors d’appels ultérieurs avec des arguments identiques.

Grâce à cette technique dite de memoization, la consommation CPU diminue et la réactivité des applications s’en trouve renforcée, ce qui est devenu crucial pour les systèmes à haute charge ou temps réel, souvent rencontrés dans le traitement de données, l’analyse ou le développement web. Mais au-delà de la simple activation du cache, comprendre ses options comme la taille maximale du cache, l’usage du paramètre typed ou la gestion dynamique du cache, permet d’affiner son usage au contexte spécifique du projet.

En complément, le module functools propose également d’autres décorateurs innovants, tels que cached_property, utilisés pour optimiser les accès aux propriétés coûteuses en calcul dans les objets Python. Des astuces ciblées et une bonne maîtrise du comportement du cache, ainsi que de sa gestion mémoire, permettent d’éviter pièges et inefficacités qui pourraient pénaliser les performances plus qu’elles ne les améliorent.

- functools.lru_cache implémente une mise en cache performante avec contrôle de la taille et distinction par type.

- Le paramètre typed différencie en cache les appels avec des arguments du même contenu mais de types distincts.

- La méthode cache_clear() pour réinitialiser le cache est fondamentale pour des scénarios dynamiques.

- Le décorateur cached_property optimise la gestion mémoire pour des attributs complexes dans des instances de classe.

- L’utilisation de ces fonctionnalités renforce aussi des aspects SEO techniques liés à la rapidité d’exécution, notamment en backend.

Comprendre le fonctionnement du décorateur functools.lru_cache pour optimiser vos fonctions Python

Le décorateur lru_cache est un outil puissant qui permet de mettre en cache automatiquement les résultats des fonctions Python, en mémorisant jusqu’à un certain nombre d’appels récents suivant la logique du cache LRU. Ce mécanisme évite la répétition de calculs coûteux en stockant les résultats associés aux paramètres d’entrées hachés. Par défaut, ce cache a une taille maximale de 128 entrées, mais cette limite est paramétrable, voire illimitée si maxsize est fixé à None.

Lorsqu’une fonction décorée par @lru_cache est appelée avec un argument déjà traité, elle renvoie immédiatement la valeur mise en cache, réduisant ainsi considérablement le temps de calcul. De plus, ce décorateur est conçu pour être thread-safe, garantissant ainsi un usage sécurisé en environnement multi-threading.

Une autre caractéristique à connaître est le paramètre typed. En réglant typed=True, le cache distingue les appels selon la nature de leurs arguments (par exemple, un entier 5 et un flottant 5.0 sont considérés séparément), évitant des erreurs de réutilisation potentielle des résultats.

Applications concrètes et exemples d’utilisation avancée

Un cas d’usage typique est le calcul de suites de Fibonacci où chaque valeur dépend des deux précédentes. L’emploi de @lru_cache(maxsize=None) supprime la redondance dans les appels récursifs et booste l’exécution. De la même manière, pour des appels réseaux ou requêtes répétées dans des API tierces, la mise en cache des résultats freine les latences et diminue le trafic inutile.

Un exemple simple illustre cela :

from functools import lru_cache @lru_cache(maxsize=32) def get_pep(number): # Récupère le texte d’une proposition d’amélioration Python (PEP) url = f"https://www.python.org/dev/peps/pep-{number:04d}/" try: with urllib.request.urlopen(url) as response: return response.read() except Exception: return b"Not Found"

Ce mécanisme peut cependant saturer la mémoire en cas d’usage abusif ou avec des arguments très variés. C’est pourquoi il est essentiel de gérer la taille du cache et de prévoir le nettoyage manuel avec cache_clear() si nécessaire, particulièrement dans des cycles de vie applicatifs longs.

Comment contrôler et analyser le cache pour un meilleur ajustement ?

La méthode cache_info() permet d’obtenir des statistiques en temps réel sur les performances du cache : nombre de hits, de misses, taille maximale et actuelle. Ces données sont précieuses pour affiner la valeur de maxsize et comprendre les comportements de vos fonctions en production.

Il est également possible de forcer la remise à zéro du cache à tout moment avec cache_clear(), notamment dans les scénarios where la donnée sous-jacente évolue rapidement ou les résultats changent fréquemment. Cela évite d’utiliser des valeurs obsolètes en cache tout en conservant les bénéfices de la mise en cache sur la majorité des cas.

Exploiter le décorateur cached_property pour une gestion mémoire efficace dans les classes Python

Dans les applications orientées objet, certaines propriétés calculées peuvent être gourmandes en ressources et répétées plusieurs fois sur une même instance. Le décorateur cached_property, introduit depuis Python 3.8, transforme une méthode en propriété dont la valeur est calculée une seule fois puis mise en cache comme un attribut normal accessible rapidement par la suite.

Contrairement à une propriété classique, qui recalculerait son résultat à chaque accès, cached_property améliore la performance globale et diminue la charge CPU, particulièrement dans le cas d’attributs complexes et immuables sur la durée de vie de l’objet.

Voici un exemple d’usage :

import statistics from functools import cached_property class DataSet: def __init__(self, data): self._data = tuple(data) @cached_property def stdev(self): # Calcul coûteux de l'écart type return statistics.stdev(self._data)

Il suffit de supprimer explicitement l’attribut pour recalculer la propriété si nécessaire, ce qui donne une flexibilité appréciable. Cette technique participe à une optimisation fine de la gestion mémoire en évitant à la fois les calculs redondants et l’occupation inutile du cache global.

Astuces pour maîtriser parfaitement functools et la mise en cache avancée

Les développeurs Python cherchant à aller au-delà de l’usage standard du LRU cache bénéficieront de stratégies complémentaires. Par exemple, combiner lru_cache avec une fonction interne optionnelle et un paramètre de contrôle permet de désactiver dynamiquement le cache selon le contexte, assurant une meilleure adaptabilité aux évolutions des données.

L’utilisation judicieuse de functools.cache sans limite de taille peut s’avérer utile quand on est sûr que le volume d’entrées ne sera pas excessif et qu’on privilégie la vitesse sur la gestion mémoire, tandis que la surveillance des paramètres de cache en production garantit un comportement maîtrisé.

Une autre piste recommandée consiste à explorer les décorateurs avancés comme cached_property pour éviter les recalculs, ou encore à coupler la mise en cache avec des designs patterns adaptés pour limiter les effets de bord et garantir une fiabilité accrue.

Qu’est-ce que le décorateur functools.lru_cache en Python ?

C’est un outil qui mémorise automatiquement jusqu’à un certain nombre de résultats d’appels de fonction récents, permettant ainsi d’éviter des recalculs coûteux lors d’appels répétés avec les mêmes arguments.

Comment choisir la taille maximale du cache avec lru_cache ?

Le paramètre maxsize définit la limite du nombre d’éléments mémorisés. Un maxsize trop petit peut entraîner peu de cache hits, tandis qu’un maxsize trop grand peut surcharger la mémoire. Il faut donc ajuster cette valeur selon les besoins et ressources disponibles.

À quoi sert le paramètre typed dans lru_cache ?

Le paramètre typed distingue les caches d’appels selon le type des arguments, évitant ainsi que des valeurs égales mais de types différents (e.g. int et float) soient considérées comme identiques dans le cache.

Quand utiliser cached_property ?

Lorsqu’une propriété calculée d’un objet est coûteuse et immuable pendant la durée de vie de l’instance, cached_property permet de ne la calculer qu’une fois et d’accéder rapidement à sa valeur ensuite.

Comment réinitialiser un cache functools ?

Il suffit d’appeler la méthode cache_clear() sur la fonction décorée pour vider le cache et forcer les prochains appels à recalculer les résultats.