La manipulation des données est au cœur de toute analyse pertinente, et le package pandas s’impose comme un outil incontournable pour travailler efficacement avec des DataFrames en Python. Qu’il s’agisse d’agréger des données, d’associer plusieurs sources ou de filtrer des informations spécifiques, maîtriser les méthodes merge, groupby et filter est essentiel pour tout professionnel de la data. Les DataFrames, structures tabulaires flexibles, permettent d’organiser des données hétérogènes et facilitent la réalisation d’opérations complexes qui combinent, résument et nettoient des jeux de données variés.

La capacité à joindre plusieurs ensembles de données via des opérations de jointure optimise l’enrichissement d’une analyse, indispensable pour mettre en lumière des corrélations jusqu’alors invisibles. Le recours à la méthode groupby ouvre la voie à des statistiques descriptives fines, adaptées à chaque segment d’information, ce qui est primordial pour extraire des insights sur des sous-groupes démographiques ou géographiques. Enfin, grâce à un filtrage ciblé, il devient possible de concentrer l’analyse sur les observations pertinentes, gagnant ainsi en précision et en efficacité. En 2026, ces techniques restent les piliers d’une manipulation de données agile, soutenant aussi bien les projets de recherche que ceux de la data science appliquée, notamment via des pipelines reposant sur pandas et ses alternatives optimisées.

Les exemples et analyses présentés s’appuient sur des jeux de données publics variés, tels que ceux de l’INSEE ou de l’ADEME, illustrant la polyvalence et la robustesse de pandas dans le traitement et la consolidation des données. Ces démonstrations concrètes clarifient les usages des fonctions stratégiques pour combiner, agréger et filtrer les données, tout en anticipant les besoins croissants d’exploration interactive et de visualisations pertinentes dans un contexte de volumes de données croissants. Ainsi, comprendre et appliquer merge, groupby et filter constitue un savoir-faire fondamental pour optimiser ses analyses sur des DataFrames.

En bref, maîtriser pandas et ses méthodes clés permet de :

associer efficacement plusieurs jeux de données pour enrichir l’analyse ;

construire des statistiques agrégées par groupes ciblés avec précision ;

affiner la sélection des données pertinentes grâce à des filtrages adaptés ;

comprendre la structure et la cohérence des données, crucial pour des études robustes ;

préparer des supports clairs et précis pour communiquer les résultats d’analyse.

Utiliser la méthode groupby pour des agrégations fines dans les DataFrames pandas

La fonction groupby est au cœur de nombreuses analyses statistiques réalisées avec pandas. Elle permet de segmenter un jeu de données en plusieurs groupes selon une ou plusieurs colonnes, pour ensuite appliquer des fonctions d’agrégation sur chacun de ces groupes. Cette technique, connue sous le modèle split-apply-combine, segmente (split) les données, applique (apply) une ou des fonctions statistiques, puis recompose (combine) un nouvel ensemble résultat.

Par exemple, à partir des données d’émissions de gaz à effet de serre au niveau communal, on peut facilement calculer le total des émissions par département ou analyser la répartition des émissions selon les secteurs d’activité. Pour cela, la syntaxe classique est :

df.groupby('colonne_groupe').agg({'colonne_valeur': 'fonction_agrégation'}),

où la fonction d’agrégation peut être la somme (sum), la moyenne (mean), ou encore le comptage de valeurs distinctes (nunique).

Cette méthode est particulièrement utile pour faire ressortir des tendances locales ou thématiques en découpage géographique, socio-démographique, ou temporel. Dans le contexte des analyses environnementales françaises actuelles, la connaissance des émissions par département a facilité la mise en place de stratégies ciblées de réduction des gaz à effet de serre. Le regroupement et l’agrégation n’offrent pas seulement un aperçu synthétique mais créent les bases d’un diagnostic précis.

Documentation de référence sur pandas DataFrame et groupby guide les développeurs et analystes pour exploiter au mieux cette méthode.

Exemple pratique : dénombrement des communes par département

Imaginez un tableau contenant les codes et caractéristiques des communes françaises ; l’objectif est de compter le nombre de communes par département. Le groupby appliqué à la colonne correspondant au département permet d’obtenir ce décompte rapidement :

communes.groupby('DEP')['COM'].nunique()

Ce type d’analyse est bénéfique pour adapter les politiques publiques aux réalités territoriales, un élément clé dans les stratégies de développement durable et d’urbanisme.

Maîtriser la fonction merge pour optimiser l’association de plusieurs DataFrames

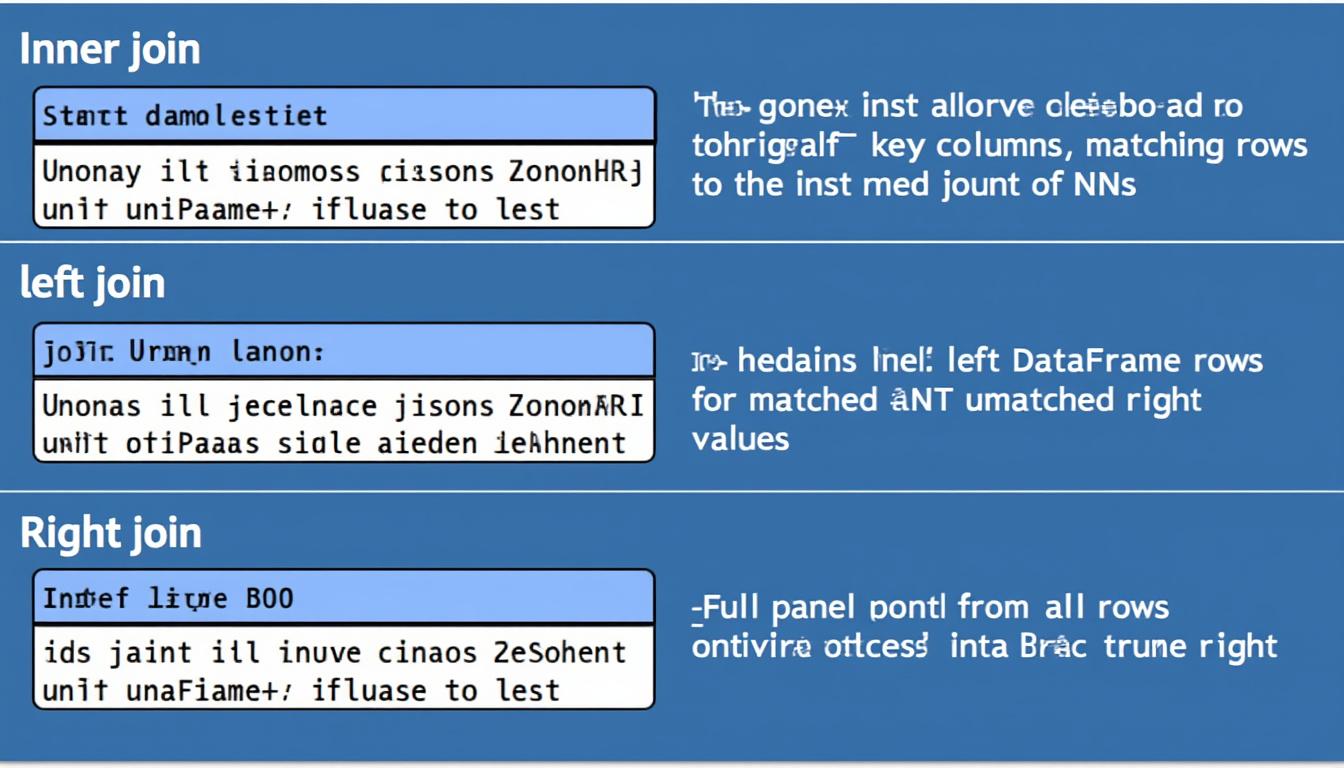

Réunir les données issues de sources différentes est une étape incontournable dans les projets d’analyse avancée. La méthode merge de pandas offre un mécanisme performant pour fusionner des DataFrames en fonction d’une ou plusieurs clefs partageant des valeurs communes. Cette jointure est comparable aux opérations JOIN en SQL, et peut se décliner en left join, right join, inner join ou full outer join, selon le comportement souhaité pour la fusion des données.

Par exemple, concaténer les données d’émissions de CO2 issues de l’ADEME avec les données socio-économiques de revenus récupérées via la base Filosofi de l’INSEE permet d’enrichir les analyses en croisant différentes dimensions. Les variables clés communément utilisées sont le code INSEE des communes et le numéro de département.

Grâce à merge, la manipulation de données devient plus dynamique, car on peut choisir le type de jointure optimal :

- left join : conserver toutes les observations du DataFrame gauche (source principale),

- right join : conserver toutes les observations du DataFrame droit,

- inner join : ne garder que les correspondances exactes aux deux DataFrames,

- outer join : conserver toutes les observations des deux DataFrames, complétant avec des valeurs manquantes quand nécessaire.

L’utilisation correcte de merge garantit ainsi une association fiable des données, indispensable à toute analyse de données robuste.

Pour ceux qui souhaitent approfondir ces techniques, la lecture disponible sur les fonctions essentielles en Python inclut un éclairage supplémentaire sur les manières d’optimiser ses scripts pandas.

Quand et comment utiliser un filtering avancé sur un DataFrame ?

Filtrer un DataFrame est une opération quotidienne qui permet de restreindre un jeu de données aux observations pertinentes selon un critère ou un ensemble de critères. La méthode filter est souvent utilisée pour sélectionner des colonnes ou appliquer des conditions sur des lignes, forçant ainsi l’analyse à se focaliser sur des sous-ensembles d’intérêt.

Par exemple, isoler les communes dont les émissions de gaz dans le secteur « Routier » dépassent un certain seuil et qui appartiennent à un département donné se fait aisément :

df.loc[(df['dep'] == '12') & (df['Routier'] > 500)]

Cette capacité de filtrage permet d’alléger les résultats, d’accélérer les traitements et d’orienter l’analyse vers des cas spécifiques, renforçant ainsi l’efficacité globale des manipulations pandas.

Au-delà des opérateurs classiques, pandas intègre également une méthode filter dédiée aux colonnes, utile pour sélectionner des variables d’intérêt par motifs, comme les secteurs liés aux émissions industrielles uniquement.

Plus d’informations sur les manipulations avancées de pandas DataFrames présentent des cas pratiques permettant d’optimiser ces filtres en contexte réel.

Les limites de pandas et les alternatives modernes pour la manipulation de données

Malgré sa puissance et sa popularité, pandas présente certaines limites, notamment lorsque les volumes de données dépassent la mémoire disponible ou que la syntaxe devient trop verbeuse voire lourde pour des chaînes de traitement complexes. Pour ces cas, des outils comme Polars, DuckDB ou encore Spark apportent des solutions plus extensibles et performantes, avec des paradigmes parfois différents.

Par exemple, Polars, en s’appuyant sur Rust et le format Arrow, offre des traitements parallélisés et une syntaxe améliorée inspirée des pratiques les plus éprouvées en data science. Quant à DuckDB, il démocratise l’usage du SQL performant directement dans les environnements Python, facilitant l’exécution de requêtes lourdes sans infrastructure complexe. Spark, par son architecture en cluster, reste un pilier dès que les jeux de données croissent de manière exponentielle.

Le choix de la technologie dépend donc du contexte d’usage, des contraintes techniques, mais aussi du besoin en interactivité et en adaptabilité des workflows d’analyse. Pour s’initier à pandas tout en comprenant les alternatives, les ressources disponibles présentent une roadmap Python du débutant à l’expert très complète.

Comment choisir entre inner join, left join et right join dans pandas ?

Le choix dépend du résultat attendu. Inner join ne conserve que les lignes présentes dans les deux DataFrames, left join conserve toutes les lignes du DataFrame gauche, complétant avec des valeurs manquantes pour celles qui n’ont pas d’équivalent à droite, et right join fonctionne de manière symétrique en conservant toutes les lignes à droite.

Quelles sont les différences entre filter et loc pour filtrer les données ?

loc permet de filtrer les lignes et/ou colonnes selon des conditions spécifiques sur les indices ou les valeurs, tandis que filter est souvent utilisé pour sélectionner des colonnes par nom ou motif. Leur usage complémentaire optimise la manipulation des DataFrames.

Est-il possible de faire des jointures sur plusieurs clés dans pandas ?

Oui, la méthode merge de pandas accepte plusieurs colonnes en paramètres left_on et right_on, permettant de réaliser des jointures complexes basées sur plusieurs variables communes.

Quels sont les avantages de Polars par rapport à pandas ?

Polars utilise une architecture basée sur Rust et Apache Arrow qui permet un traitement plus rapide et efficace, notamment sur les grands volumes de données, avec une syntaxe plus moderne et plus simple pour enchaîner les opérations.

Comment afficher un DataFrame pandas sous forme de tableau attrayant ?

Le package great_tables permet de créer des tableaux HTML enrichis et dynamiques en Python, facilitant la communication des résultats, notamment lors des phases d’exploration et de présentation des données.