Le traitement des données est devenu un enjeu crucial dans le paysage numérique actuel. Avant de pouvoir analyser ou modéliser efficacement un jeu de données, une étape incontournable se présente : le nettoyage des données. En 2026, avec l’explosion des volumes de données collectées, cette phase est essentielle pour garantir la fiabilité des analyses et optimiser les performances des modèles de Machine Learning. Cependant, cette tâche peut s’avérer longue et complexe, représentant souvent jusqu’à 80 % du temps d’un projet data. Pandas, bibliothèque Python incontournable, offre un panel d’outils puissants pour automatiser ces opérations, rendant le processus plus accessible et reproductible. Cet article explore les différentes techniques et pratiques pour créer un outil de data-cleaning efficace avec Pandas, de l’exploration initiale jusqu’à la préparation avancée, en passant par la gestion des valeurs manquantes, la suppression des doublons ou encore la conversion des types de données.

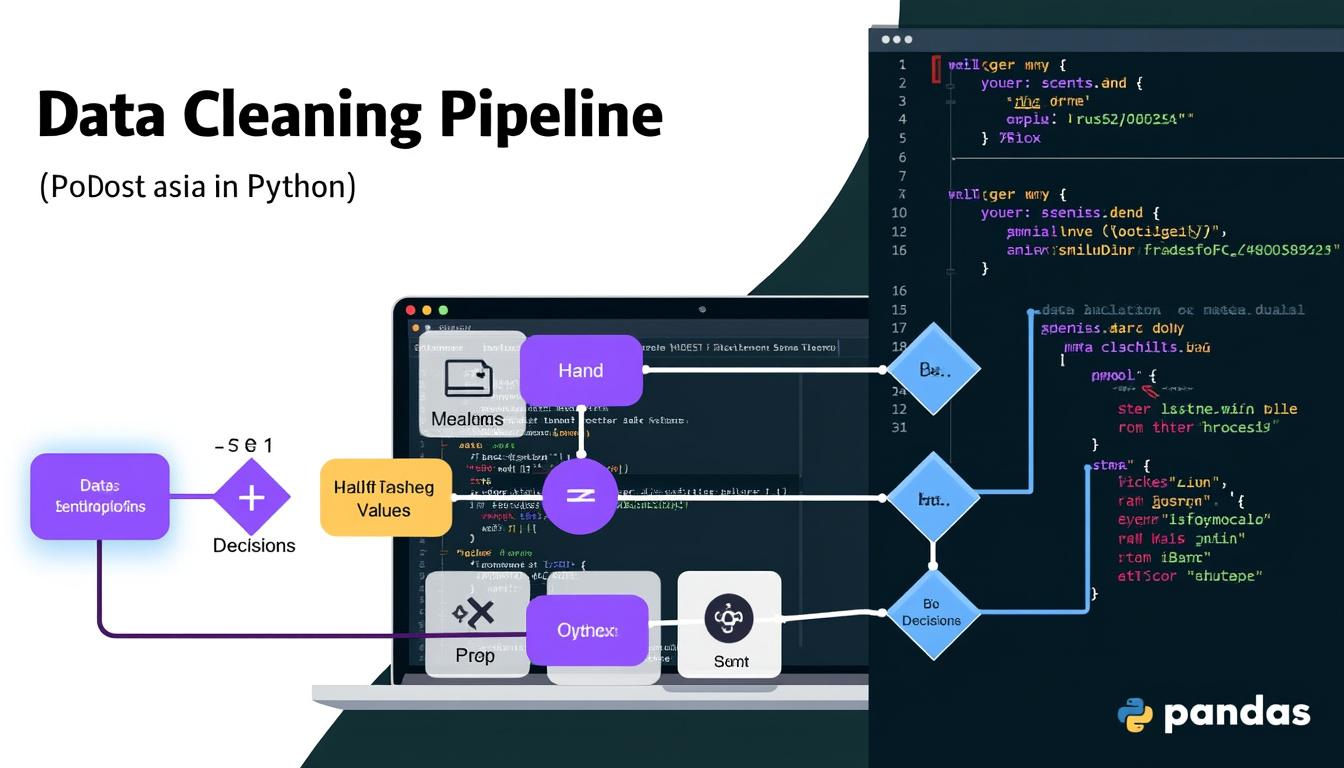

Le nettoyage de données est une condition sine qua non pour une manipulation de données sans failles et un traitement optimisé. Il implique également un regard critique sur le jeu initial afin d’identifier rapidement les anomalies, incohérences ou redondances qui pourraient compromettre la qualité de l’à venir analyse. S’orienter vers une automatisation progressive du nettoyage est désormais un atout majeur, surtout dans un contexte où la volumétrie et la variété des données tendent à augmenter. Cette démarche pragmatique ne vise pas seulement à corriger les erreurs par répétition manuelle, mais à mettre en place une pipeline robuste capable de gérer et standardiser le flux de données entrant de manière autonome.

En bref :

L’outil de data-cleaning avec Pandas permet de préparer les données en répondant à plusieurs exigences essentielles : détection et traitement des valeurs manquantes, identification et suppression des doublons, renommage des colonnes pour une meilleure lisibilité, et conversion judicieuse des types de données pour optimiser les performances de traitement. Cette approche méthodique aide à fiabiliser vos analyses et facilite la mise en production de modèles de Machine Learning. Intégrer ces pratiques dans une routine d’automation rend le nettoyage répétable et efficace, une nécessité pour quiconque traite des données en 2026.

Explorer et comprendre son jeu de données avec la bibliothèque pandas

Avant toute intervention de nettoyage, il est primordial de bien cerner la nature et la structure du jeu de données. Utiliser Pandas pour cette phase d’analyse exploratoire permet d’obtenir une vue d’ensemble complète. Par exemple, la méthode df.info() révèle le type de données de chaque colonne, indiquant les formats numériques, textuels ou booléens. En examinant df.describe(), on obtient des statistiques clés telles que la moyenne, l’écart-type et les quartiles pour les colonnes numériques, tandis que pour les colonnes catégoriques, il est possible d’identifier les fréquences des valeurs.

Identifier rapidement la présence de valeurs manquantes ou d’entrées dupliquées constitue une étape critique. Pandas offre la méthode df.isna().sum() pour quantifier les NaN par colonne et repérer précisément les données absentes. Cette inspection permet aussi d’élaborer un diagnostic sur la qualité générale, conditionnant ensuite les choix de nettoyage.

Adopter les bonnes stratégies pour le traitement des données manquantes

Les valeurs manquantes sont souvent inévitables dans les bases réelles, et leur gestion dépend du contexte métier et du volume des données absentes. Pandas met à disposition diverses méthodes adaptables. La fonction fillna() permet par exemple de remplacer ces valeurs par des constantes — comme zéro — ou des statistiques calculées telles que la moyenne, médiane ou le mode. Il est essentiel d’appliquer ces remplacements avec discernement, par exemple lors du nettoyage d’une colonne ‘Shape Reported’, où remplacer les NaN par le terme par défaut ‘VARIOUS’ peut améliorer la cohérence de la base.

Une autre option consiste à supprimer ces valeurs manquantes avec la méthode dropna(). Il est possible d’éliminer uniquement les lignes affectées ou, avec précaution, des colonnes entières lorsque le nombre de données manquantes est trop élevé pour être exploitable. Ce choix doit être réfléchi, car une suppression excessive peut entraîner une perte d’information critique.

Détecter et supprimer les doublons pour garantir la fiabilité de vos données

Les doublons peuvent fausser les résultats d’analyse ou même conduire à des modèles biaisés. Pandas propose les méthodes duplicated() pour localiser les lignes en double ainsi que drop_duplicates() pour les supprimer efficacement. L’identification peut se faire sur toutes les colonnes ou un sous-ensemble spécifique, selon la définition métier de ce qui constitue un doublon.

Il est recommandé d’examiner d’abord les duplications détectées, notamment en variant le paramètre keep pour choisir si l’on conserve la première, la dernière ou aucune occurrence. Une suppression raisonnée, suivie de vérifications post-traitement via df.shape, assure la qualité du jeu de données nettoyé avant d’éventuelles étapes ultérieures.

Conversion des types de données et opérations sur les chaînes avec pandas

Un des fondamentaux du data-cleaning est l’alignement correct entre type de données et contenu attendu. Par exemple, un prix saisi en chaîne de caractères (type object) doit être converti en float pour permettre des calculs ou modélisations adéquats. La méthode astype() est la solution de référence pour modifier les types, assurant cohérence et performance lors des analyses.

Par ailleurs, pour les données textuelles, Pandas offre une gamme d’opérations introduites via l’attribut .str, permettant de normaliser les chaînes (passage en minuscules ou majuscules), réaliser des remplacements ciblés ou extraire des sous-chaînes. Ces outils sont essentiels pour harmoniser les labels ou corriger les erreurs typographiques fréquemment rencontrées dans les données textuelles collectées.

Optimiser l’organisation des données par renommage et réindexation

Pour faciliter la compréhension et l’analyse, il est souvent nécessaire de renommer les colonnes à des dénominations plus explicites ou localisées. Par exemple, transformer ‘Shape Reported’ en ‘Forme’ et ‘Colors Reported’ en ‘Couleur’ clarifie le contenu pour les utilisateurs francophones.

Ensuite, la réorganisation des colonnes via une réindexation adaptée, par exemple selon l’ordre ‘City’, ‘Forme’, ‘Couleur’, ‘State’, ‘Time’, offre une structure logique optimisant les opérations d’analyse ou d’exportation. Ces ajustements, bien que souvent sous-estimés, contribuent fortement à une meilleure prise en main des données dans les phases ultérieures.

Vers l’automation et l’efficacité à grande échelle

Mettre en place un outil de data-cleaning basé sur Pandas ouvre la voie à des processus automatisés robustes. L’efficience obtenue repose sur la combinaison séquentielle de pratiques standardisées : inspection initiale, traitement des valeurs manquantes, nettoyage des doublons, conversion et enrichissement des données. Cette pipeline automatisée libère les équipes des tâches répétitives, sécurise la qualité des bases, et permet de concentrer davantage les efforts sur des problématiques analytiques de plus haut niveau.

En 2026, avec la généralisation des environnements de données volumineuses, créer un tel outil flexible et adaptable est devenu indispensable pour assurer la scalabilité et la pérennité des projets en science des données.

Comment identifier rapidement les valeurs manquantes dans un DataFrame Pandas ?

La méthode df.isna().sum() permet de quantifier les valeurs manquantes par colonne, offrant un aperçu rapide des données absentes dans le jeu de données.

Quelle méthode Pandas utiliser pour supprimer les doublons ?

df.drop_duplicates() supprime efficacement les lignes en double. Pour un contrôle plus fin, on peut aussi utiliser df.duplicated() pour identifier ces doublons avant suppression.

Comment modifier le type d’une colonne dans Pandas ?

La fonction astype() permet de convertir les types de données. Par exemple, convertir une colonne d’objets en type float est réalisé via df['colonne'] = df['colonne'].astype('float').

Quelle stratégie pour gérer les valeurs manquantes ?

Selon le contexte, il est possible d’utiliser fillna() pour remplacer les valeurs manquantes par une valeur fixe ou statistique (moyenne, médiane, mode). Alternativement, dropna() peut supprimer lignes ou colonnes contenant des NaN lorsque ces dernières sont trop nombreuses ou non exploitables.

Pourquoi le renommage et la réindexation des colonnes sont-ils importants ?

Renommer les colonnes améliore la lisibilité et la compréhension du jeu de données, tandis que la réindexation organise les données dans un ordre logique, facilitant les analyses ultérieures et la manipulation.