La transformation numérique en 2026 place l’intelligence artificielle au cœur des interactions humaines, avec une montée en puissance notable des assistants personnels. Ces agents, grâce à des avancées en traitement du langage naturel et machine learning, facilitent les tâches quotidiennes en automatisant des processus complexes via des interfaces conversationnelles intuitives. Grâce à Python, langage incontournable de la programmation en IA, il est désormais accessible de développer un assistant personnel intelligent qui comprend, apprend et interagit de manière fluide. Ce tutoriel expose les fondements techniques et pratiques pour créer un assistant performant, intégrant des éléments comme la reconnaissance vocale, la gestion de mémoire contextuelle et l’intégration d’API, essentiels pour une expérience utilisateur enrichie et personnalisée.

En bref : cet article met en lumière la création d’un assistant personnel en utilisant les puissantes bibliothèques Python dédiées à l’IA, incluant notamment LangChain, OpenAI, et FAISS. Il introduit les concepts essentiels des agents intelligents, de leur environnement aux algorithmes de prise de décision, en insistant sur une approche modulable et évolutive. Des exemples concrets expliquent l’intégration du traitement du langage naturel, de la mémoire à long terme, et du déploiement via API. Finalement, l’adoption de fonctionnalités avancées comme le multimodal ouvre la porte à une automatisation plus riche et personnalisée.

Maîtriser la création d’un assistant personnel IA performant en Python

La conception d’un assistant personnel IA repose d’abord sur la compréhension approfondie des agents d’intelligence artificielle, qui combinent perception, raisonnement et action dans un environnement dynamique. Le recours à Python s’impose grâce à son écosystème particulièrement riche et sa capacité à interfacer des modules spécialisés dans l’automatisation. La clé est l’implémentation d’algorithmes adaptés en machine learning et l’intégration efficace de composants dédiés au traitement du langage naturel, garantissant une interaction naturelle avec l’utilisateur.

Essentiels pour installer et configurer un environnement Python dédié à l’IA

Avant d’entamer le développement, l’installation d’un environnement Python stable est cruciale. Ce dernier doit comprendre des bibliothèques majeures telles qu’OpenAI, LangChain, Transformers de Hugging Face, FAISS pour la recherche vectorielle, ainsi que des frameworks d’API comme Flask ou FastAPI pour assurer la communication entre l’assistant et les applications externes. La simplicité d’installation via pip facilite ce processus et garantit un déploiement rapide.

L’installation des packages essentiels s’effectue avec la commande suivante :

!pip install openai langchain transformers sentence-transformers faiss-cpu tiktoken llama-index numpy pandas scikit-learn flask

Pour débuter dans la programmation IA avec Python, un guide concret sur coder Python IA gratuitement offre des ressources complémentaires afin d’optimiser l’apprentissage.

Définition claire des objectifs pour un assistant personnel intelligent

Il est primordial, dès le départ, de fixer l’objectif de l’assistant. Il peut s’agir d’un agent capable de répondre à des questions, d’un moteur de recherche synthétisant de vastes données, voire d’un automate connecté à des services tiers. Cette définition conditionne le choix des technologies employées, notamment en matière de modèles de langage et d’architecture logicielle.

Implémentation avancée du traitement du langage naturel pour une interaction efficace

Le cœur de tout assistant réside dans sa capacité à comprendre et générer du langage naturel. Utiliser les modèles GPT d’OpenAI ou les Transformers proposés par Hugging Face permet de bâtir un chatbot fluide, capable d’échanges complexes. La syntaxe Python suivante illustre cette intégration :

from transformers import pipeline

chatbot = pipeline("conversational", model="microsoft/DialoGPT-medium")

response = chatbot("What is the capital of France?")

print(response)

Cette approche garantit une réponse dynamique et naturelle aux requêtes utilisateurs, fondée sur un apprentissage profond.

Optimiser la mémoire à long terme et la base de connaissances de votre assistant IA

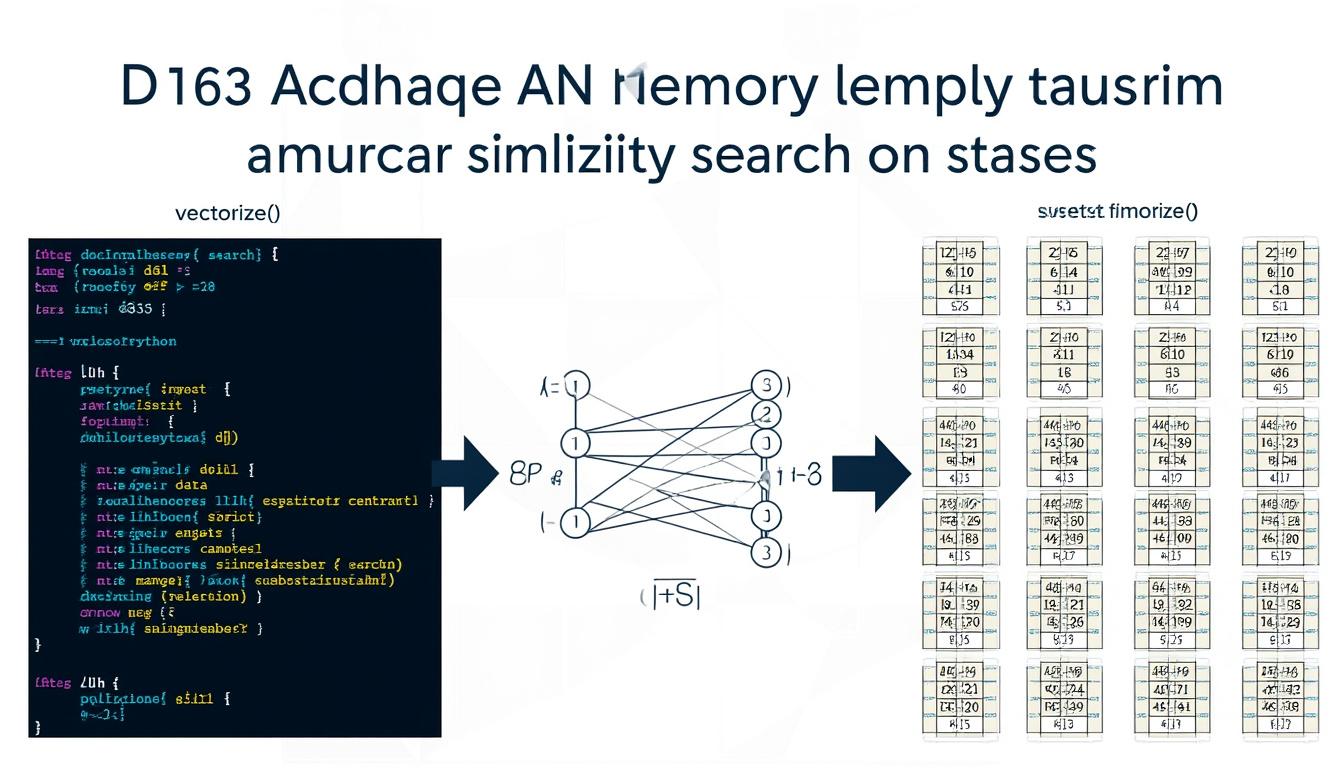

Pour offrir une expérience utilisateur riche, la mémoire contextuelle est indispensable. Elle permet à l’assistant de conserver des informations pertinentes entre plusieurs interactions, améliorant ainsi la pertinence des réponses. On s’appuie souvent sur des bases de données vectorielles comme FAISS ou LlamaIndex, qui facilitent la recherche rapide de documents et le classement des connaissances dans un espace multi-dimensionnel.

Un exemple concret d’implémentation :

from llama_index import GPTVectorStoreIndex, SimpleDirectoryReader

documents = SimpleDirectoryReader("data").load_data()

index = GPTVectorStoreIndex.from_documents(documents)

query_engine = index.as_query_engine()

response = query_engine.query("Explain quantum computing")

print(response)

De plus, la gestion des vecteurs à l’aide de FAISS lui permet de garder un historique des interactions et de rechercher des réponses similaires, augmentant ainsi la cohérence des dialogues au fil du temps. Plus d’informations sur ce mécanisme sont abordées dans cet article sur la reconnaissance vocale et ses applications intégrées.

Approches modernes pour améliorer la prise de décision automatisée

Au-delà de la simple réponse, un assistant doit pouvoir prendre des décisions pertinentes. En 2026, l’apprentissage par renforcement et l’ingénierie rapide des prompts avec les technologies GPT 4 turbo permettent d’aiguiser cette capacité. Le client Python OpenAI facilite l’appel aux modèles de décision :

from openai import OpenAI

client = OpenAI()

def ai_decision(prompt):

response = client.chat.completions.create(

model="gpt-4-turbo",

messages=[{"role": "user", "content": prompt}]

)

return response.choices[0].message["content"]

decision = ai_decision("Should I invest in Bitcoin?")

print(decision)

Cette architecture apporte une flexibilité déterminante dans l’interaction avec l’utilisateur, ainsi qu’une capacité d’adaptation aux contextes variés.

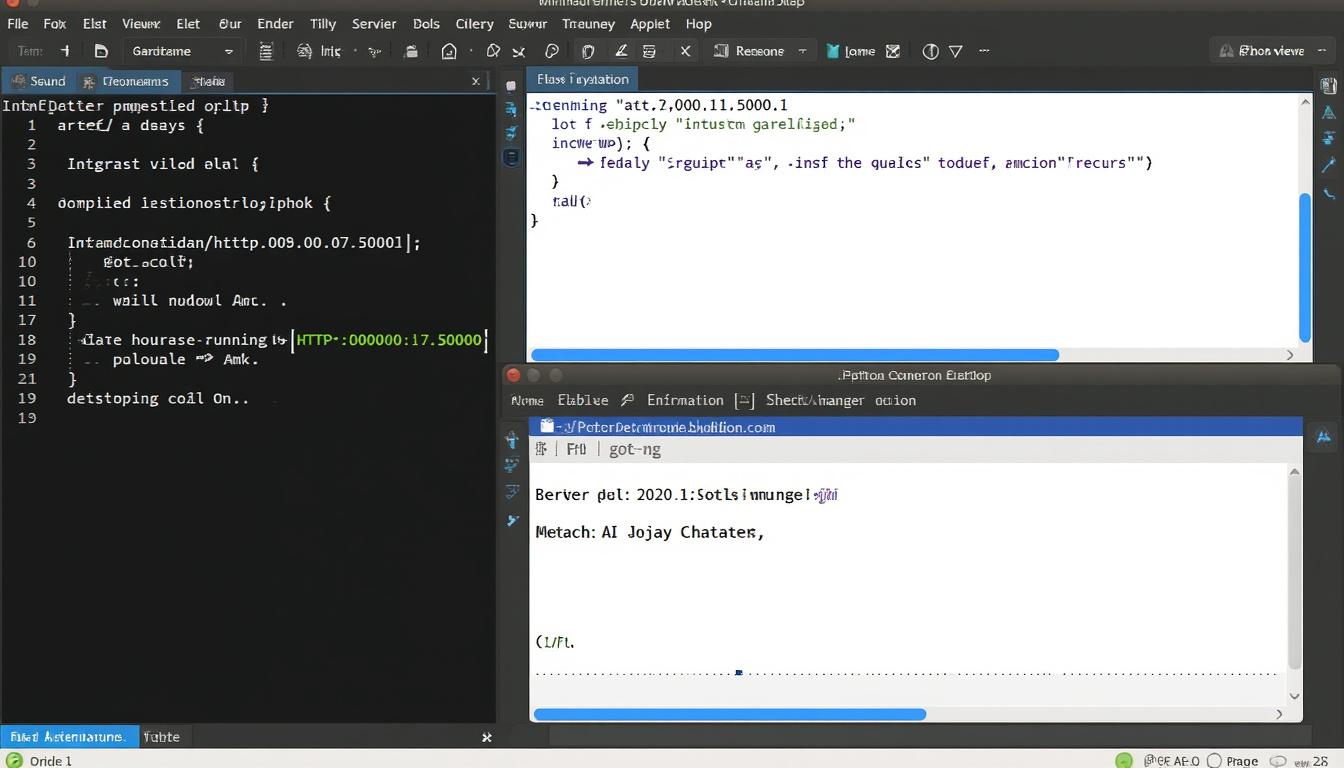

Déployer et étendre l’accessibilité de votre assistant personnel Python via API

Pour assurer l’accès en temps réel à l’assistant, exposer un point API via Flask ou FastAPI reste une stratégie privilégiée. Ce déploiement permet l’intégration dans des environnements divers et la création d’interfaces vocales ou graphiques. Un exemple minimaliste en Flask :

from flask import Flask, request, jsonify

app = Flask(__name__)

@app.route('/chat', methods=['POST'])

def chat():

user_input = request.json['message']

response = ai_decision(user_input)

return jsonify({'response': response})

if __name__ == '__main__':

app.run(debug=True)

Cette modularité favorise l’adaptation de l’assistant à différents besoins métier ou personnels. Pour garantir une installation optimale, diverses ressources décrivent comment installer Python sur systèmes variés.

Potentiel d’innovation avec des fonctionnalités multimodales et web scraping

Faire évoluer un assistant personnel implique de dépasser la seule gestion textuelle. L’intégration de capacités multimodales rassemble gestion des images, sons et vidéos, permettant une interaction plus riche. Par ailleurs, l’utilisation de techniques comme le scrapping via BeautifulSoup ou Selenium offre la possibilité de puiser des données en temps réel, ouvrant le champ à des applications toujours plus proactives et personnalisées.

De plus, l’intégration aux API de services comme les prévisions météorologiques, les finances ou la messagerie électronique approfondit significativement le spectre fonctionnel offert par l’assistant personnel.

Quels sont les prérequis pour développer un assistant personnel IA avec Python ?

Il est essentiel d’avoir une bonne maîtrise des bases de Python et du traitement du langage naturel. L’installation d’un environnement avec des bibliothèques comme OpenAI, LangChain et FAISS est également indispensable.

Comment intégrer la reconnaissance vocale dans un assistant IA Python ?

La reconnaissance vocale peut être intégrée via des bibliothèques spécialisées telles que SpeechRecognition. Ce processus permet à l’assistant d’interpréter et de répondre à des commandes vocales.

Peut-on améliorer la prise de décision automatique de son assistant personnel ?

Oui, en utilisant des modèles d’apprentissage par renforcement et les capacités avancées de GPT-4 turbo, on peut entraîner l’assistant à prendre des décisions plus adaptées et contextuelles.

Quelles sont les meilleures pratiques pour déployer un assistant personnel IA ?

Déployer l’assistant via Flask ou FastAPI, en créant une API REST, permet une intégration facile et une mise à jour rapide des fonctionnalités.

Quels sont les atouts des bases vectorielles comme FAISS dans un assistant personnel ?

Elles améliorent la gestion de la mémoire contextuelle en facilitant la recherche rapide d’informations pertinentes, optimisant ainsi la fluidité et la pertinence des interactions.